Mainboard o_o

Member

AMD xác nhận CPU Ryzen "Phoenix" được hỗ trợ bởi động cơ AI của Xilinx đang chạy trong phòng thí nghiệm của họ

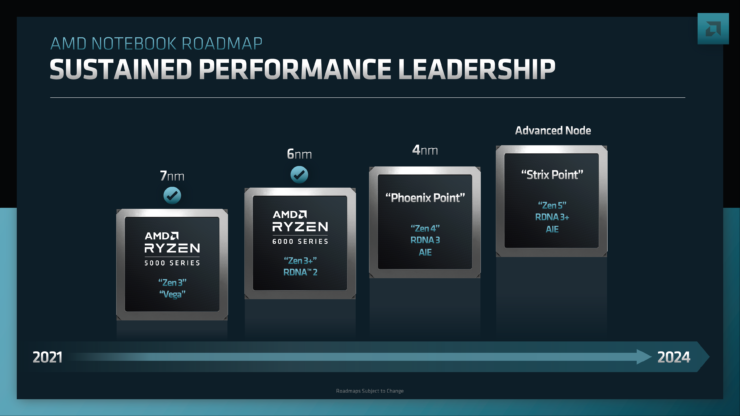

Trong một tweet của nhà phân tích công nghệ David Schor , Chủ tịch Nhóm Máy tính Thích ứng và Nhúng của AMD đã xác nhận trong Hội nghị thượng đỉnh phần cứng AI rằng họ đã chạy CPU Ryzen thế hệ tiếp theo của khách hàng trong phòng thí nghiệm của họ và sử dụng công cụ tăng tốc AI của Xilinx. Vì Ryzen đã được đề cập, chúng ta có thể chỉ ra rằng đây là những CPU Phoenix Point sắp tới đã được xác nhận là có AI Engine trở lại tại Ngày phân tích tài chính năm 2022 . Dòng tweet được cung cấp bên dưới:Điều này cũng xác nhận rằng AMD đã chính thức trang bị CPU Phoenix Point và vì nó đang chạy trong phòng thí nghiệm của họ nên nó sẽ trải qua một quá trình xác nhận nghiêm ngặt trước khi đưa vào sản xuất hàng loạt vào năm tới. AMD dự kiến sẽ giới thiệu CPU Phoenix Point của mình cho các nền tảng PC di động mỏng và nhẹ tại CES 2023 và sẽ sử dụng cấu trúc đặt tên hoàn toàn mới đã được công ty chi tiết gần đây . Các APU Phoenix Point sẽ là một phần của dòng AMD Ryzen 7000.

CPU di động dòng AMD Phoenix Point "Ryzen 7040"

AMD đã xác nhận dòng sản phẩm APU Phoenix Point của mình sẽ sử dụng cả lõi Zen 4 và RDNA 3. Các APU Phoenix mới sẽ hỗ trợ LPDDR5 và PCIe 5 và có các SKU khác nhau, từ 35W đến 45W. Dòng sản phẩm này cũng dự kiến sẽ ra mắt vào năm 2023 và hầu hết có thể là tại CES 2023. AMD cũng đã chỉ ra rằng các bộ phận của máy tính xách tay có thể bao gồm các công nghệ bộ nhớ ngoài LPDDR5 và DDR5.

Dựa trên các thông số kỹ thuật trước đó, có vẻ như các APU Phoenix Ryzen 7000 vẫn có thể mang đến 8 lõi và 16 luồng với số lõi cao hơn chỉ dành cho chip Dragon Range. Tuy nhiên, các APU Phoenix sẽ mang số CU cao hơn cho lõi đồ họa RDNA 3, nâng cao hiệu suất lên một mức rất lớn so với bất kỳ thứ gì mà đối thủ có thể phải cung cấp. Các APU Phoenix Point cũng sẽ là sản phẩm đầu tiên của AMD có AIE hoặc AI Engine giúp tăng tốc các tác vụ dành riêng cho AI.

Động cơ này sẽ dựa trên IP được phát triển bởi Xilinx mà AMD đã mua lại với giá 35 tỷ đô la Mỹ vào năm 2020 . AIE sẽ nhắm mục tiêu "Bộ xử lý đa năng" VPU này cũng chịu trách nhiệm xử lý các tác vụ dựa trên AI và dự kiến sẽ ra mắt trong các CPU Raptor Lake thế hệ thứ 13, sau đó là tích hợp đầy đủ trong các chip Thế hệ thứ 14 Meteor Lake.

https://wccftech.com/amd-already-ha...ix-cpus-with-xilinx-ai-engine-running-in-labs